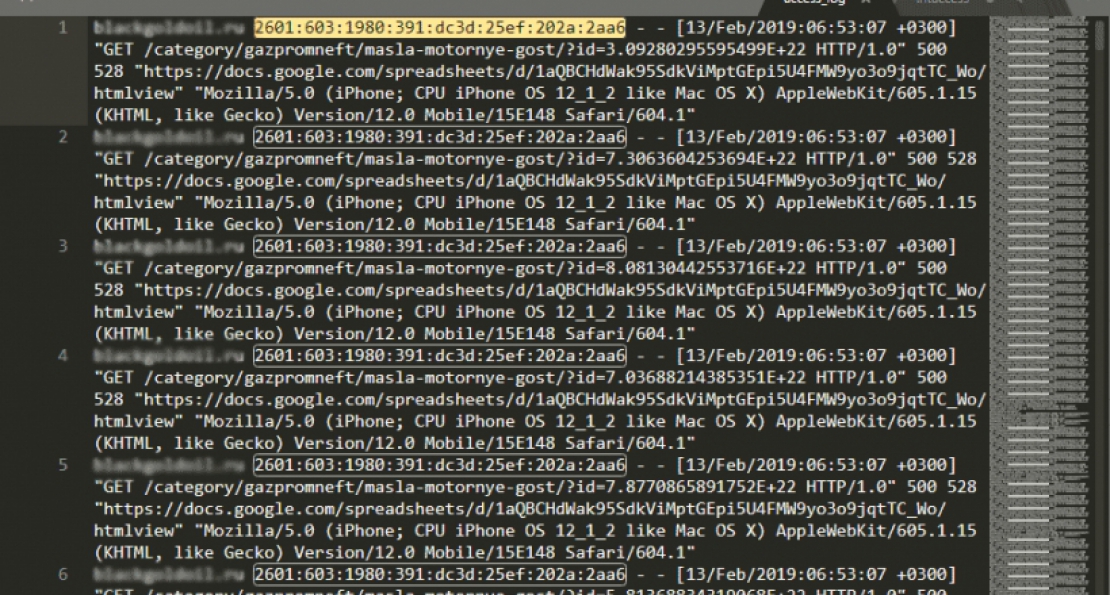

По сути Googlebot просто перебирает все возможные адреса, например:

/category/catalog/?id=6.08560625443234E

/category/catalog/?id=5.62491544345784E

У Adam Audette, в блоге есть большая статья о канонических url, https://www.merkleinc.com/blog/ecommerce-seo-product-variations-colors-and-sizes

Чаще всего нагрузка создается со следующих адресов

66.249.83.84

66.249.83.85

66.102.8.79

66.102.8.78

66.102.8.17

66.102.7.15

66.102.8.85

66.102.8.84

66.102.8.87

Что делать в данной ситуации?

Как известно, Google игнорирует Crawl-delayпоэтому если сайт не зарегистрирован в Google Search Console, то регистрируем. Затем в настройках выставляем скорость сканирования сайта – вручную.

Изменения должны вступить в силу в течение 1–2 дней, но на практике срок может составить более 3 суток.

Если хостер дал определённый срок, на снижение нагрузки, и в него явно не укладываетесь, то заблокируйте на время адреса, с которых идут множественные запросы.

Да, на несколько дней индексация будет не недоступна для Google, но это намного лучше того, что если ваш сайт будет заблокирован, он выпадет из всех поисковиков. Возможно поисковик перенаправит поисковые запросы через ivp6, тогда просто удалите АААА-запись для домена в настройках DNS

Пока писался материал, на Sucuri появился похожий материал, ознакомиться можно по ссылке